過度依賴AI,會有哪些隱憂?

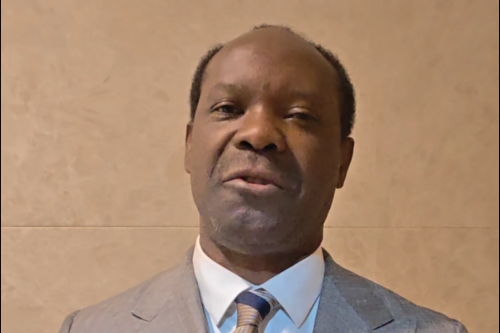

有人這樣形容現在的生活:信息看手機,娛樂靠微信,購物用快遞,吃飯點外賣,我們的生活越來越“宅”。12月2日,在2025年“讀懂中國”國際會議(廣州)的平行論壇上,第十四屆全國政協委員、經濟委員會委員,中國網絡空間安全協會理事長趙澤良分享了他對人工智能發展中存在的潛在風險的思考。

趙澤良認為,我們應該善用人工智能而不是過度依賴人工智能,要關注AI帶來的結構性權力風險、信息退化、網絡生態改變、責任斷裂失衡等現實問題。

記憶力、社交能力等或退化

“大腦用則進,退則廢。”趙澤良認為,過度依賴AI可能會帶來記憶力退化、方位感退化、文字能力退化、認知偏差和社交能力退化等隱憂。

“以前讓你記住10個以上電話號碼,小菜一碟;現在能記住10個以上電話號碼的人,是不是不多了?”趙澤良解釋道,有心理學研究表明,越容易獲得的信息,大腦越傾向于遺忘。如今,智能手機已經成為我們大腦的“外存”,這可能會導致大腦的“內存”變小。

“智能GPS導航出現前,出門靠記路;現在,離開導航軟件,我們寸步難行。為什么?”他提出,有研究表明,長期依賴導航的人,在陌生環境中定位、辨別方向、找路徑的能力明顯下降。他特別提醒,要注意對兒童、青少年的影響,“過早依賴導航會導致海馬體發育不足。”

你是不是經常“提筆忘字”?除了網絡熱梗,你還知道怎么表達自己的想法嗎?趙澤良指出,對生成式人工智能(以下簡稱“GAI”)的依賴,會讓個性化的語言風格被同化;通過書寫來鍛煉的大腦與手部精細動作的協調配合控制能力也會受到影響。

“遣詞造句的過程是讓我們的想法思路變得更清晰的過程。如果跳過這個過程,我們的想法就會變得碎片化、模糊化,很難形成深度洞見。”趙澤良說。

認知偏差和社交能力退化也是不容忽視的現實問題。

在線上學習、工作、娛樂已經高度便捷化、個性化、實景化的今天,趙澤良認為,長期沉迷于短視頻、專注于聊天APP會弱化我們長時間專注、親近、交流的能力,導致注意力碎片化,真實場景的社交靈敏度、共情能力、交往能力等也可能變弱。

趙澤良認為,廣泛閱讀和深度閱讀是鍛煉、訓練大腦思維能力的重要途徑。如果人們長期習慣被動接受GAI生成的要點、結論,自身的批判性思維、創造性思維能力可能會下降,從而形成信息繭房、認知偏差。

人工智能的發展有哪些風險?

從技術角度分析,人工智能的發展可能面臨哪些風險?趙澤良提出,算法權力不透明、集中化,應該引起重視。“我們已經出現算法、算力、數據、模式等基礎設施被少數企業壟斷的苗頭,模型參數等不透明也讓技術標準很難做到公平公正,監管部門也缺乏有效介入手段。”

此外,GAI信息污染帶來的影響也不容忽視。他提出,隨著AI生成內容成本的持續降低,人的“聲音”在網絡空間的“密度”正在下降,驗證區分“AI數據”和人的真實“聲音”的難度在增加。

“當假圖、假視頻、假信息、假歷史大量涌現時,它將會對社會認知、公信力、公共治理帶來不利影響。”趙澤良認為,這些“垃圾內容”“信息霧霾”可能會影響整個社會,一旦真相被噪音淹沒,信任基石就可能崩塌。

此外,AI醫生、AI智駕的潛在隱患也應引起重視。“AI決策一旦出錯,該誰負責?”他提出,要解決AI發展中已經出現或可能出現的問題,必須要進一步推進AI的良性發展,以防范、避免、解決這些隱患。

羊城晚報記者 張璐瑤

社會新聞精選:

- 2025年12月04日 22:00:09

- 2025年12月04日 18:05:04

- 2025年12月04日 15:06:39

- 2025年12月04日 13:41:13

- 2025年12月04日 13:38:23

- 2025年12月04日 10:18:14

- 2025年12月04日 06:33:00

- 2025年12月04日 00:25:53

- 2025年12月03日 19:23:15

- 2025年12月03日 19:23:07

京公網安備 11010202009201號

京公網安備 11010202009201號